碼農學寫字

到处看看,一起聊聊上一篇博文是偷懒的结果。

我把应大学同学邀约,和他的CS学生们聊AI的英文底稿,交给AI翻译。

承蒙博友可能成功的P点明中间一大段不清不楚,让人看不明白。

现在把那不光荣的历史藏起来了。把可能成功的P的留言搬到这里。

最西边的岛上看了我投在美语坛的英文原稿,也看了中文翻译。西岛姐更指出,英文原稿比AI翻译的中文容易理解。

唉,我真不能偷懒,马上被捉包。只好重写一次,把比较专业的部分也去掉了,只说故事吧。

前几天,我的一位同事跟我讲了他偶然看到的一个影片。影片里的人做了各种各样的事情,但有一件事他们就是不做。

他们不会在脸上挥舞三根手指。

原来,这是一段AI生成的影片。

在脸上挥舞三根手指,是辨识「深度伪造」(Deepfake)的常用技巧。

但是,这可能已经不是可靠的测试方法。

因为AI领域变化非常迅速。

举个例子,上周五我参加了在麻省理工学院举办的AI Summits。

其中一位小组成员是MIT教授,解释人脑的工作原理。他说:“人类可以将我们学到的知识转化为图表。AI做不到这一点。”

主持人打断了他,说:

“教授,那是老黄历了。AI现在可以呦。”

教授很惊讶,问道:“从什么时候开始的?”

主持人说:“大约两周前。”

和ChatGPT同时出现的还有一个名词,Generativ AI。

什么是Gen AI?

生成式人工智慧基上就是机率。所以相同的问题,每次给的答案不一定完全一样。有时候可能还错的离谱,所以你不能完全信任AI。

为什么是这样呢?因为,他的回答不是经过和人类一样的「思考」。而是从逻辑模式来预测下一个词,然后从最有可能出现的词中进行选择。

然后它又重复一遍。

一遍,又一遍。

感觉像是思考。

实际上,是一连串非常复杂的猜测。

一个简单的比喻:

它就像是你手机的自动补全功能,只不过是加强版。

它不知道答案。

它只是知道最有可能的答案是什么。如果,没有任何答案时,AI会捏造。

纽约发生过一个案例。

一位律师引用了ChatGPT列举的案例。

问题是,这些案例并不存在。

法官判律师罚款5000美元。

AI听起来很有说服力,连律师都被骗。

所以你必须需自己验证。

怎么验证?

你可以要求AI逐步解释它的推理过程,它是如何得出结论的?它从哪里获得资讯的?

有一位朋友是法学教授,发表过很多论文。最近,他正在写一篇新论文,需要一些例子和案例来佐证他的观点。他使用AI模型来辅助搜索,不出所料,AI模型给出了一些支持他理论的案例。

但我的朋友是一位经验丰富的学者,他会要求提供资料来源。 AI提供了引用处。

法学教授用另一个AI模型对这些引文进行了交叉检查。

结果,根本找不到来源。

于是他回到原模型,非常直接地问道:“我无法核实来源。这是你编造的吗?”

人工智慧大方的承认了。

这种情况会一而再再而三地发生。

所以,你必须学会??怀疑结果,深入分析,持续验证结果。

这样的思考能力不是与生俱来的。

但是,我们有几个世纪的哲人和智者留下许多文史让我们学习。现代学者还能利用科学,与我们的大脑活动交互验证,重新思考。

介绍几本改变了我的思考方式的书。

丹尼尔卡尼曼的(Daniel Khneman)《思考,快与慢》(思考,快与慢)

卡尼曼的书告诉读者:

不能只相信自己的直觉,必须问问自己:

“我真的经过深思熟虑了吗?还是只是直觉反应?”

尤瓦尔·诺亚·赫拉利(Yuval Noah Harari)《人类简史》和《Nexus》。

在 《人类简史》,哈拉里的观点是:人类一直以来都坚信某些被重述千万遍的「故事」(Story)。所以写故事的人,无形中左右了我们的想法。

《人类简史》让你质疑我们所相信的故事。

在 Nexus 中,他指出,「更多资讯并不意味着更多真相」。

而是,谁控制了资讯,谁就因掌握资讯而获得权力。

读完这本书,让我在听完某些叙事之后,会想:是谁在讲这些故事?他的目的是什么?

亚当·格兰特(Adam Grant)《再想一遍》(Think Again)。

这篇是关于重新思考,如何质疑自己的假设。

如果卡尼曼展示了思考方式是如何出错的,格兰特则告诉你该怎么改进错误的思考方式。

祝您阅读愉快!

英文原稿

https://bbs.wenxuecity.com/mysj/333357.html

看到“人工智能大方地承认了”,我要笑出来了。他们真的很诚实哈LOL

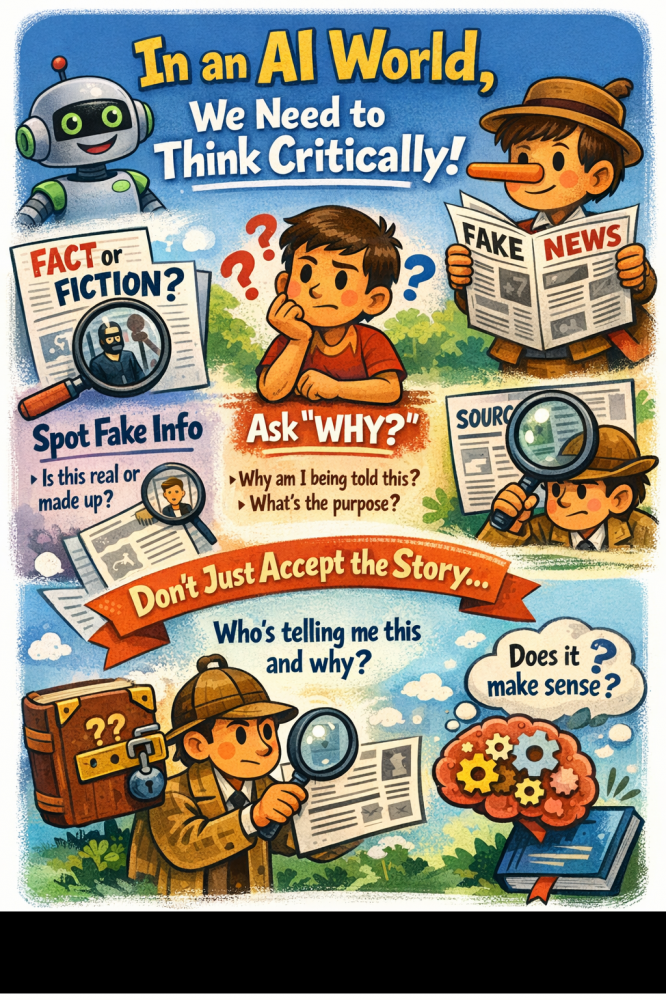

后面的配图很棒!现在个人的判断力太重要了。我也看过丹尼尔卡尼曼的(Daniel Khneman)《思考,快与慢》,握手!

开始的部分看懂了,中间的看不懂,后来又懂了。码农厉害,佩服!

我们这些“文科生”目前还只是用AI做research多,经常被欺骗。而且都很脸大。我一般都会交叉检查,然后告诉他错了。他就会很matter of fact地说,是的,就是你说的这样,完全忘了刚才犯过错的事实。还有就是阿谀奉承的手段越来越娴熟 :-{